金磊 发自 凹非寺米兰

谁能思到啊,在自转头模子(Autoregressive,AR)当说念的目下,一个非主流架构的模子瞬息杀了回马枪——

被遥远视为学术玩物的扩散谈话模子,顺利在复杂编程任务中飙出了892 tokens/秒的速率!

你没看错,当主流大模子还在以几十token的速率逐字蹦词时,这个非主流模子依然在100B参数限度上,跑出了如斯的速率。

2025年,蚂鸠集团资深期间群众赵俊博也曾带着LLaDA2.0登上量子位MEET大会的舞台,而如今,他们的最新版块LLaDA2.1来了,蚂蚁期间盘考院重磅开源!

三个月前,在LLaDA2.0时间,这更多是一个充满挑战的盘考性模子。

而这一次,LLaDA2.1的出身,符号着这个道路的历史性转换。它不再仅仅一个“学术盘考”,而是真确可用、致使在恶果上更为优厚的坚定用具。

那么在通盘行业都在卷更大的自转头模子时,蚂蚁到底是奈何低调修了另一条“能跑通的高速公路”的?

接下来,咱们就再全部扒一扒这个非共鸣期间背后的旨趣。

奈何作念到的?

在潜入期间之前,咱们先得聊聊为什么目下的ChatGPT、Claude们老是慢慢悠悠。

因为它们着实全部经受自转头架构,这种模样如归拢个不成打草稿的考生,必须从左到右、逐字逐句地生成文本,写完即定稿,无法回头修改。

而扩散模子的表面上风在于并行,不错同期处理通盘文本位置,表面上能一次成篇,领有宏大的速率后劲。

但扩散谈话模子在早期一直有个致命伤,那即是容易瞎掰八说念,且枯竭全局一致性。因为并行生成时,各个部分可能是各玩各的,导致前后文逻辑欠亨。

为此,蚂蚁的LLaDA2.1先亮出了第一个期间杀手锏:

一个模子两种模样假想,把奈何用模子的权柄交给用户

基于可纠错裁剪的底层才调,LLaDA2.1引入了生动的双模样解码战术,竣事了单个模子,同期复旧极速与质料两种模样:

Speedy Mode(极速模样):大幅裁减τ_mask阈值,激进并行生成初稿,幸运飞艇app下载依赖T2T裁剪进行后期修正。符合代码草稿、快速推理、多轮试探式生成等对迷糊量敏锐的场景。

Quality Mode(质料模样):经受保守阈值,减少裁剪次数,优先保险输出准确性。符合负责文档生成、高精度推理等对放置质料要求严苛的神气。

在此之前,LLaDA-MoE和LLaDA2.0需要二次建立提供额外的加快版块,比如基于旅途蒸馏的加快等;这类加快版块因为非营救熟谙优化,天然竣事了对基础版块的一定加快,然而精度掉点大批严重;同期一个模子多个版块,也加多用户遴荐的难度以及模子照看的老本。

单模子双模样,幸免了上述问题。用户不错根据具体需求,仅需一条config就能竣事模样切换。

这种假想符号着LLaDA系列从盘考模子向实用居品的重要转换。

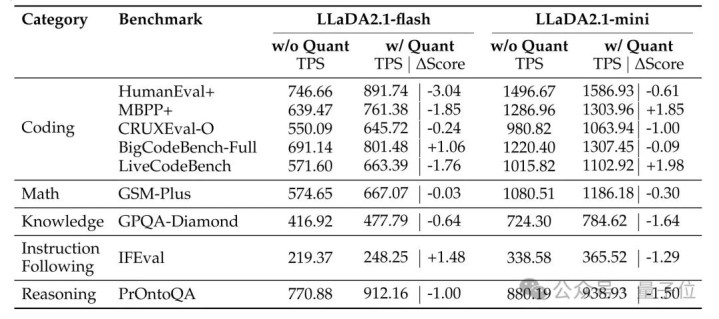

期间讲演走漏,在HumanEval+编程基准上,LLaDA2.1-flash(100B)在Speedy Mode下达到892 TPS的峰值速率,而Quality Mode则在多项推理任务上非凡了前代模子。

可纠错裁剪,让模子像东说念主类通常“写稿+修改”

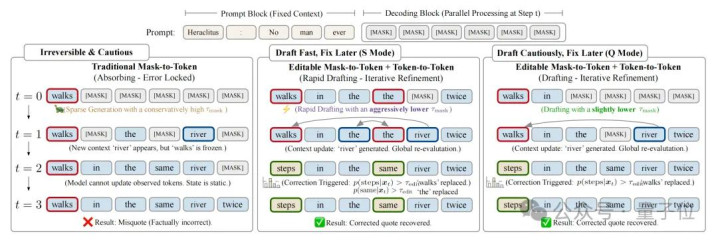

为了更好的解析双模样背后的机制,咱们不错回忆一下我方写稿的历程。

自转头模子像是一个不允许带草稿纸、不允许带提纲的作家,它动笔无悔,MILAN SPORTS不允许修改我方写好的骨子。

但执行中,大部分情况下咱们可能是先有了思法去写草稿,哪怕有错别字,先动笔写着;写完之后,咱们再回头细读一遍,把欠亨顺的、有错别字的方位改掉。

LLaDA2.1责任旨趣恰是如斯,引入的机制叫作念可纠错裁剪(Error-Correcting Editable,ECE)。

它的推理过程被分为了两个阶段:

阶段一(M2T, Mask-to-Token):模子以极高的速率,并行生成一个草稿。这个阶段可能会有一些噪声和特地,但速率极快。

阶段二(T2T, Token-to-Token):立即开动裁剪模样。模子站在全局视角,对刚才生成的草稿进行查抄。若是发现某些token置信度低大要逻辑欠亨,就顺利进行回溯式修正。

期间讲演中的一个例子生动评释了其价值。

当模子尝试补全赫拉克利特名言“No man ever steps in the same river twice”时,传统扩散模子在早期设施特地生成了“walks”,由于气象冻结,最终输出特地的“walks in the same river twice”。

而LLaDA2.1在后续设施中检测到“steps”的置信度更高,温和将“walks”替换为“steps”,顺利规复正确引文。

这种允许自我修正的才调,从根底上科罚了扩散模子的曝光偏差问题。它让模子勇于在初稿阶段追求速率,再通过裁剪阶段保险质料。

它在毫秒级的闪电采样中完成了“草稿”到“正卷”的丽都回身,不再被困在序列的开始,而是顺利站在全局的高度,去裁剪、去重塑、去界说AGI时间的推理新范式。

这是第一次在扩散架构上竣事了速率与质料的解耦。

初次在100B扩散谈话模子上跑通强化学习

若是说可纠错裁剪科罚了奈何生成的问题,那么强化学习则是科罚了生成得好不好的问题。

但此前,在扩散模子上运用RL曾被视为不可能的任务。

原因在于,自转头模子的序列似然可顺利领悟为token级概率乘积,而扩散模子基于块状采样(block-diffusion),序列级似然难以顺利筹划,导致传统战术梯度门径失效。

LLaDA2.1团队为此定制了EBPO(ELBO-based Block-level Policy Optimization)算法:

以根据下界(ELBO)当作序列似然的代理筹算;

通过向量化似然揣测期间,并行筹划多时期步的块要求概率;

假想特地的梯度结实机制,适配扩散模子的裁剪特质。

这是业界初次在100B限度扩散模子上顺利引申大限度RL熟谙。

放置不言而喻:LLaDA2.1在IFEval(提醒罢黜评估)、BFCL(函数调用)等对皆类任务上显赫晋升,解说扩散模子不仅能快,更能懂你。

鱼和熊掌,不错兼得

正如咱们刚才提到的,LLaDA2.1百亿参数版块在处理HumanEval+等复杂编程任务时,竣事了892 tokens/秒的峰值速率。

在同级别的基准测试中,这一速率线路依然对主流自转头架构造成了显赫上风。

更值得眷注的是,这种速率并非以糟跶质料为代价。

在训练场上,郭兴福常常亲自示范,从卧倒射击的姿势到冲锋突围的路线,每个细节都抠得仔仔细细。士兵们不再觉得训练枯燥,反而个个劲头十足。这套教学法一经推广,就迅速引发全军学习热潮,甚至得到了高层的高度肯定。

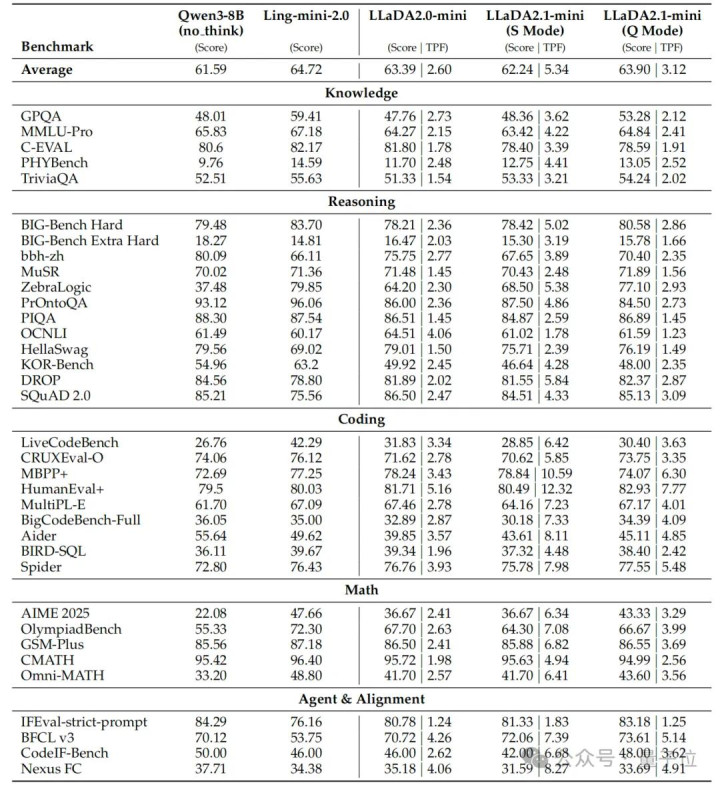

在涵盖常识、推理、代码、数学及提醒罢黜的33个泰斗基准测试 中,LLaDA2.1在质料模样下全面非凡了前代LLaDA2.0。

即使在追求速率的极速模样下,其性能下落也一丁点儿,真确作念到了 “鱼与熊掌不错兼得”。

除此以外,团队还开源了16B的Mini版块,其在部分任务上的峰值速率致使逾越1500 tokens/秒,为更轻量化的部署提供了可能。

临了,LLaDA2.1背后的形而上学亦然值得说说念说说念。

它解说了一件事:

在大模子时间,有敢把非共鸣走到底的耐烦,亦可获得顺利。

— 完 —

量子位 QbitAI · 头条号

眷注咱们米兰,第一时期获知前沿科技动态

备案号:

备案号: